안녕하세요.

이번 글에서는 디지털 뉴딜 사업의 일환인 AI hub를 소개하려고 합니다.

최근 딥러닝 학습을 하기 위해 양질의 데이터가 절실히 필요한 상황입니다.

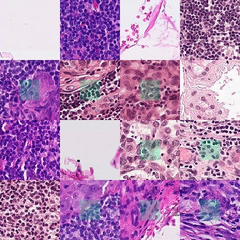

특히, 의료 데이터의 경우에는 우수 인력들이 동원되어야 학습데이터를 구축 할 수 있습니다.

그래서 정부에서는 대규모 투자를 하여 양질의 데이터를 생산할 수 있게 지원하고 있는데,

그 중의 하나가 디지털 뉴딜 사업이고, 이러한 디지털 뉴딜 사업의 일환이 AI hub입니다.

그래서 딥러닝을 공부하고 모델을 개발하는 사람들이 데이터를 구하는데 어려움이 없도록 AI hub에 신청하면 다양한 데이터 (ex: 공공의료데이터, 위성데이터 등) 를 제공 받을 수 있습니다.

이번 글에서는 위에서 설명한 내용들을 좀 더 구체적으로 알아보도록 하려고 합니다.

디지털 뉴딜을 설명하기에 앞서 뉴딜이 무엇이고, 한국판 뉴딜이 무엇인지 먼저 알아본 후 디지털 뉴딜과 AI hub에 대해서 설명하도록 하겠습니다.

1. 뉴딜이 무엇인가요?

루즈벨트를 미국 역사상 최초로 4번 연속 대통령으로 이끌었던 정부주도 사업이 뉴딜정책입니다.

이 뉴딜 정책을 설명하기 위해 잠시 짧게 역사적인 배경을 설명하도록 하겠습니다.

1) 1865년 미국: 남북전쟁 종료

- 1865년 미국의 남북전쟁이 끝나면서 통합된 정부가 수립이 됩니다.

2) 1865~1918년 미국: 미국 재건 시작

- 이 시기에 유럽을 중심으로 다른 대륙에서 2750만 명이라는 이민자들이 미국으로 몰려들어오게 됩니다.

- 이러한 이민자들 덕분에 노동력을 공급 받을 수 있었고, 캘리포니아와 같이 개발되지 않은 지역에 다양한 지역 사회를 형성할 수 있었습니다.

3) 1920년 미국: 미국 경제 호황

- 1918년 1차 세계대전이 영국, 러시아, 프랑스 연합국의 승리로 끝났습니다.

- 당시 영국은 러시아와 프랑스에 엄청난 돈을 빌려준 상태였습니다.

- 하지만, 영국 역시 전쟁 중 이었기 때문에 부족한 돈을 미국 금융가에게서 빌리게 됩니다.

- 영국은 미국에게 빌린 돈을 패전국인 독일에게 막대한 배상금을 주며 받으려 했습니다.

- 물론, 러시아와 프랑스에게 빌려줬던 돈도 받아 미국에게 주려고 했습니다.

- 하지만, 유럽의 경제는 이미 파탄이 난 상태였기 때문에 영국과 미국 모두 돈을 받기 힘든 상태가 되었습니다.

- 그래서, 미국은 유럽 경제를 살리기 위해 대규모 투자를 하여 공장을 늘리고 많은 일자리(노동자)를 만들어 냈습니다. 이로 인해 투자가 활발해 지면서 미국 또한 대규모 경제 호황을 맞이하게 됐죠

(↓↓↓ 미국의 1920년대 배경을 잘 설명해주는 동영상↓↓↓)

https://www.youtube.com/watch?v=xatt7AQPnMc

4) 1930년 미국: 미국 경제 대공황

- 늘어난 공장을 통해 공급이 수요를 앞서게 되자 기업가 또는 투자자들의 이윤이 줄어들게 되었습니다.

- 그러자 노동자들을 해고시켜 노동임금을 줄이고 이윤을 증가시키려고 했습니다.

- 하지만, 노동자들이 곧 수요자였기 때문에 미국 경제는 공장도 멈추고 대규모 실업자가 생겨나게 됩니다.

(↓↓↓1930년대 미국 대공황을 잘 설명한 영상↓↓↓)

https://www.youtube.com/watch?v=1W3_kkmHR5I

5) 1930년 미국: 미국 경제 대공황

- 1933년 루즈벨트 대통령은 미국의 경제 대공황을 극복하고자 뉴딜 정책을 실시합니다.

- 뉴딜 정책중 하나가 대규모 토목 사업인 후버 댐 건설입니다.

- 서부개척과 이민자들의 유입으로 서부지역의 환경을 개선할 필요가 있었습니다.

- 하지만, 특히 후버 댐이 건설되기 전까지 홍수 또는 가뭄에 의해 적절한 농업을 할 수 없게 되었죠.

- 그래서 후버 대통령 (1929년 3월 4일 ~ 1933년 3월 4일) 은 1931년에 농장을 현대화하고 전력을 공급하고 홍수를 억제하기 위해 엄청난 규모의 댐 공사를 추진합니다. 그리고, 자신의 이름을 따 댐의 일음을 후버 댐이라고 명명합니다.

- 루즈벨트 대통령은 본래 하고 있던 후버 댐 사업을 이어받아 1935년에 준공(=공사를 마침)을 선언합니다.

결국 뉴딜 정책이란 아래와 같이 정리할 수 있습니다.

"경제 위기를 극복하고자 정부에서 지원한 대규모 공공사업"

2. 한국판 뉴딜은 무엇인가요?

2020.04.22일 청와대 제5차 비상경제회의에서 정부가 국가 프로젝트로써 한국판 뉴딜을 구상하겠다는 의사를 처음 밝힙니다.

코로나와 일자리 문제로 인한 경제 위기를 극복하고자 정부에서 대규모 공공사업을 진행하려고 한 것이죠.

그리고 2020.07.14일에 '한국판 뉴딜' 국민보고대회를 통해 1시간 정도 '한국판 뉴딜' 정책 설명을 진행합니다.

(↓↓↓'한국판 뉴딜' 국민보고대회 관련 뉴스 (풀영상은 따로 검색하면 1시간 짜리 영상이 나옵니다↓↓↓)

https://www.youtube.com/watch?v=8baEZB88dNY

'한국판 뉴딜' 정책은 크게 두 가지 사업(정책)으로 구성되어 있습니다.

- 디지털 뉴딜

- 그린 뉴딜

2020.07.14일 발표한 '한국판 뉴딜 1.0'에서는 2025년까지 국고 114조원, 민간과 지자체 포함 160조원을 투자하여 관련 일자리를 창출할 것이라고 밝혔습니다.

'한국판 뉴딜 1.0'의 방향성은 아래 "그림1"과 같이 '10대 대표과제'를 통해 파악할 수 있습니다.

https://www.korea.kr/special/policyCurationView.do?newsId=148874860

[정책위키] 한눈에 보는 정책 - 한국판 뉴딜

1. 한국판 뉴딜이란?2.한국판 뉴딜의 구조와 추진체계3.분야별 주요 내용4.한국판 뉴딜 주요 추진과제5.한국판 뉴딜 펀드 6.사례로 본 한국판 뉴딜 7.그 밖의 참고자료 / 누리집 1. 한국판 뉴딜이란?

www.korea.kr

그리고 1년 뒤 2021.07.14일에 '한국판 뉴딜 2.0'을 발표하게 됩니다.

'한국판 뉴딜1.0'의 방향성을 그대로 가져가면서 투자액을 좀 더 증액할 것이라고 합니다.

https://www.youtube.com/watch?v=ap0Wz5CTMOM

앞서 언급했듯이 '한국판 뉴딜' 정책은 크게 두 가지로 분류 할 수 있습니다.

- 디지털 뉴딜

- 그린 뉴딜

앞서 디지털 뉴딜에 대해서 알아보기로 했으니, 지금부터 디지털 뉴딜에 대해 좀 더 자세히 설명드리도록 하겠습니다.

3. 디지털 뉴딜은 무엇인가요?

'한국판 뉴딜' 중 하나의 중심축을 담당하는 디지털 뉴딜은 크게 세 가지 방향성을 갖고 있습니다.

- 데이터 댐

- 지능형 정부

- 스마트 의료인프라

여기서 제가 소개해 드릴 부분은 "데이터 댐"과 "스마트 의료인프라"입니다.

3-1. 데이터 댐

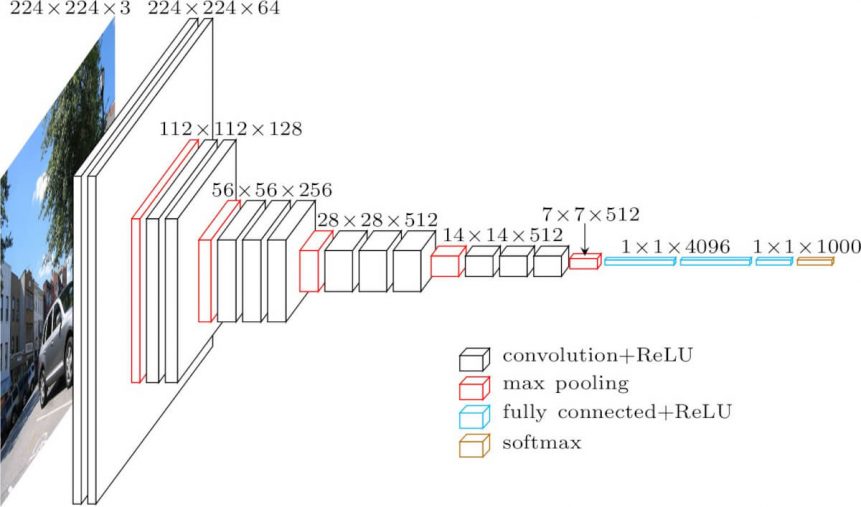

오늘 날 적용하는 인공지능의 대표격인 딥러닝은 크게 두 가지 요소를 필요로 합니다.

- 데이터

- 딥러닝 모델 with 학습 방법론

학계에서 열심히 연구하는 부분들은 "2. 딥러닝 모델 with 학습 방법론"입니다.

수 많은 연구자들이 어떻게 하면 효율적인 딥러닝 모델을 만들 수 있을지 연구하여 논문으로 발표합니다.

하지만, 이러한 딥러닝 연구가 진행되기 위해서 반드시 선행되어야 하는 작업이 있습니다.

바로 딥러닝 모델을 학습 시키기 위한 '데이터'를 만드는 작업입니다.

결국 양질의 '데이터'가 있어야 효율적인 인공지능 연구들이 가능합니다.

그래서 정부는 디지털 뉴딜의 일환으로 데이터들을 한 곳에 저장 시킬 "데이터 댐"을 만들기로 합니다.

정부는 데이터 댐에 관련 이야기를 언급하면서 "D.N.A 생태계 강화"를 강조했습니다.

'D.N.A'는 'Data. Network. AI' 약자인데, 데이터들을 하나의 저장소(=데이터 댐)에 모아 5G 기반의 통신만 기술을 이용해 AI 관련 사업하는 사람들에게 제공하면 어떻게 될까요?

위와 같이 공공 데이터 저장소가 있으면 많은 인공지능 기업과 연구자들이 데이터를 모으는 수고를 덜 면서 연구에만 몰두 할 수 있게 됩니다.

(↓↓↓'디지털 뉴딜'에서 데이터 댐에 관한 설명↓↓↓)

https://www.youtube.com/watch?v=9iNjaG72SSo

(↓↓↓'데이터 댐' 관련 설명↓↓↓)

https://www.youtube.com/watch?v=EWIq6aWxbdg

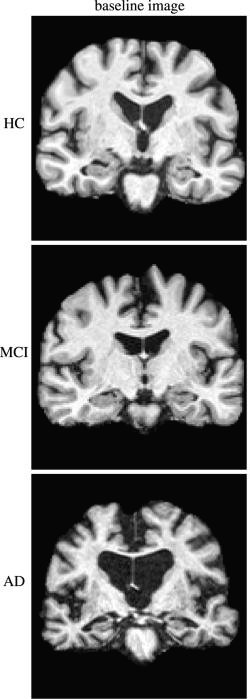

3-2. 스마트 의료인프라

의료가 인공지능 및 IT와 결합하면서 개선될 수 있는 부분은 굉장히 많습니다.

몇 가지 예를 들면, 웨어러블 디바이스 또는 실시간 감지를 통해 사람의 생처정보 및 행동패턴을 분석하여 환자들을 지속 관찰할 수 도 있고, 성능 좋은 의료인공지능 모델로 인해 정확성 높고 더 빠른 진료를 가능하게 할 수도 있습니다. 또한 원격의료 시스템을 지원할 수 도 있고, 불필요한 중간체계를 줄여주어 의료비용을 감소시킬 수 도 있습니다.

(↓↓↓디지털 헬스케어와 관련해서 작성한 글↓↓↓)

https://89douner.tistory.com/195?category=986138

1. 미국의 Healthcare환경 및 의료시스템

안녕하세요. 이번 글에서는 미국의 healthcare환경 및 의료 시스템에 대해서 알아보도록 하겠습니다. 사실, 각 나라마다 의료환경이 다릅니다. 예를 들어, 유럽의 의료환경, 한국의 의료환경, 미국

89douner.tistory.com

(↓↓↓디지털 뉴딜 사업 중 "스마트 의료인프라"관련 영상↓↓↓)

https://www.youtube.com/watch?v=d2d6-hRXXg4

결국 의료분야에서 인공지능 모델을 이용하려는 연구자들은 위에서 언급한 '데이터 댐', '스마트 의료인프라'와 모두 관련있는 일을 하고 있으시다고 보셔도 될 것 같습니다.

4. AI hub는 무엇인가요?

만약 본인이 의료 인공지능을 연구하고 있다고 하신다면 연구를 어떻게 하고 있으신가요?

딥러닝 모델, 그 외 인공지능 학습방법론 등과 관련된 분야들 (ex: unsupervised learning, domain adaptation, CNN, GNN, etc ...) 을 연구하시고 있으실텐데, 이러한 연구를 하기 위해서는 데이터가 필요하실 겁니다.

보통 의료 분야에서 인공지능 모델을 연구하기 위한 방법은 두 가지 입니다.

- 사설 병원 (ex: 서울아산병원, 삼성서울병원, 서울대병원, 연세대병원, 고려대 병원 등..)의 private dataset을 이용한 연구 진행 방식

- Kaggle, MICCAI 에서 개최하는 challenge에서 제공해주는 public dataset을 이용한 연구 진행 방식

Private dataset은 양질의 데이터이지만 일반 연구자들이 접근하기가 쉽지 않고, public dataset의 경우에는 접근성은 좋지만 품질이 떨어지는 경우가 종종 있습니다.

그래서 정부는 양질의 데이터를 공공 개방할 수 있도록 '데이터 댐'을 만들기로 했는데, 이를 대표하는 곳이 AI-hub라는 곳입니다. (미리 말씀 드리면 의료 데이터는 다른 데이터들에 비해 데이터를 신청하는 것이 까다롭습니다. 아무래도 사람과 관련된 데이터라 엄격할 수 밖에 없겠죠? 하지만, private dataset은 보통 해당 기관 사람 아니면 접근이 거의 불가능 한 점을 보면 상대적으로 이용하기 수월하다고도 할 수 있을 것 같습니다)

(↓↓↓ AI-hub 사업 설명 영상↓↓↓)

https://www.youtube.com/watch?v=sEFPh1f63aE

(↓↓↓ AI-hub 사이트↓↓↓)

홈 | AI 허브

AI 데이터를 찾으시나요? AI 학습에 필요한 다양한 데이터를 제공합니다. 원하시는 분야를 선택해 보세요.

aihub.or.kr

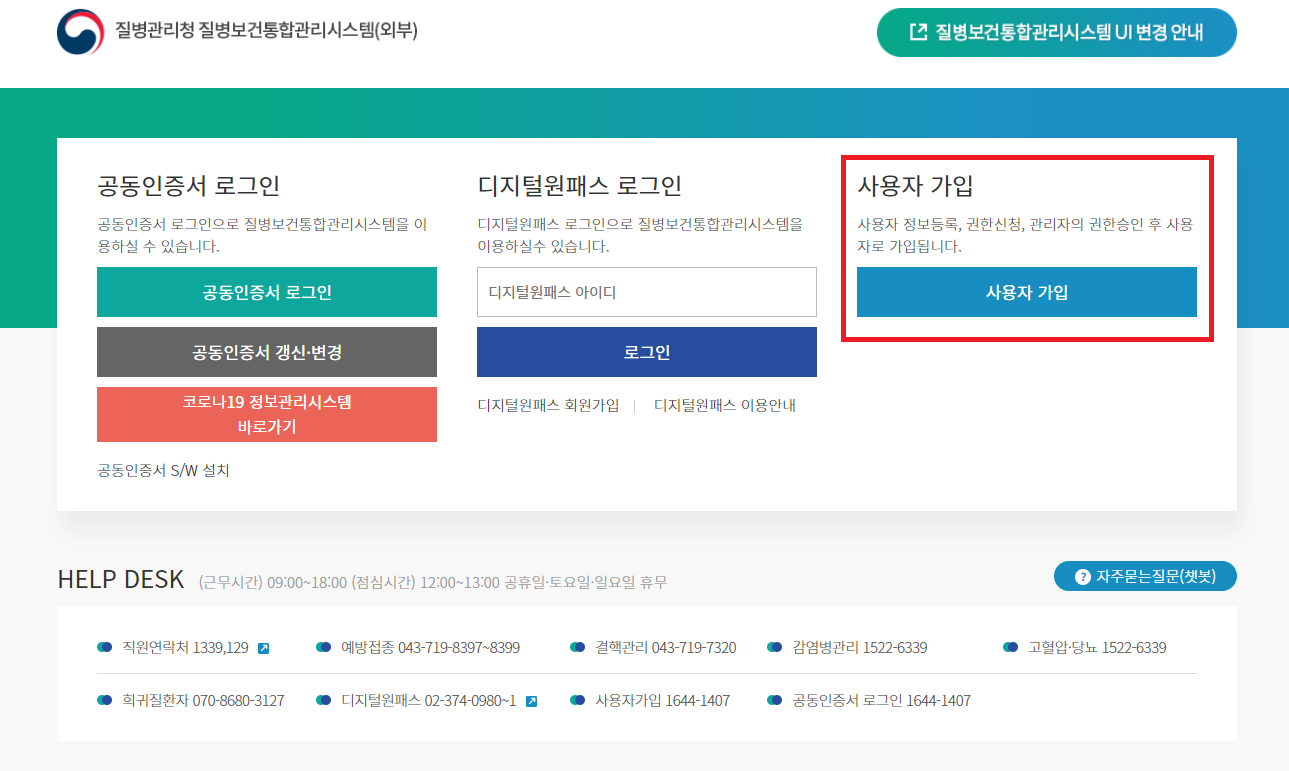

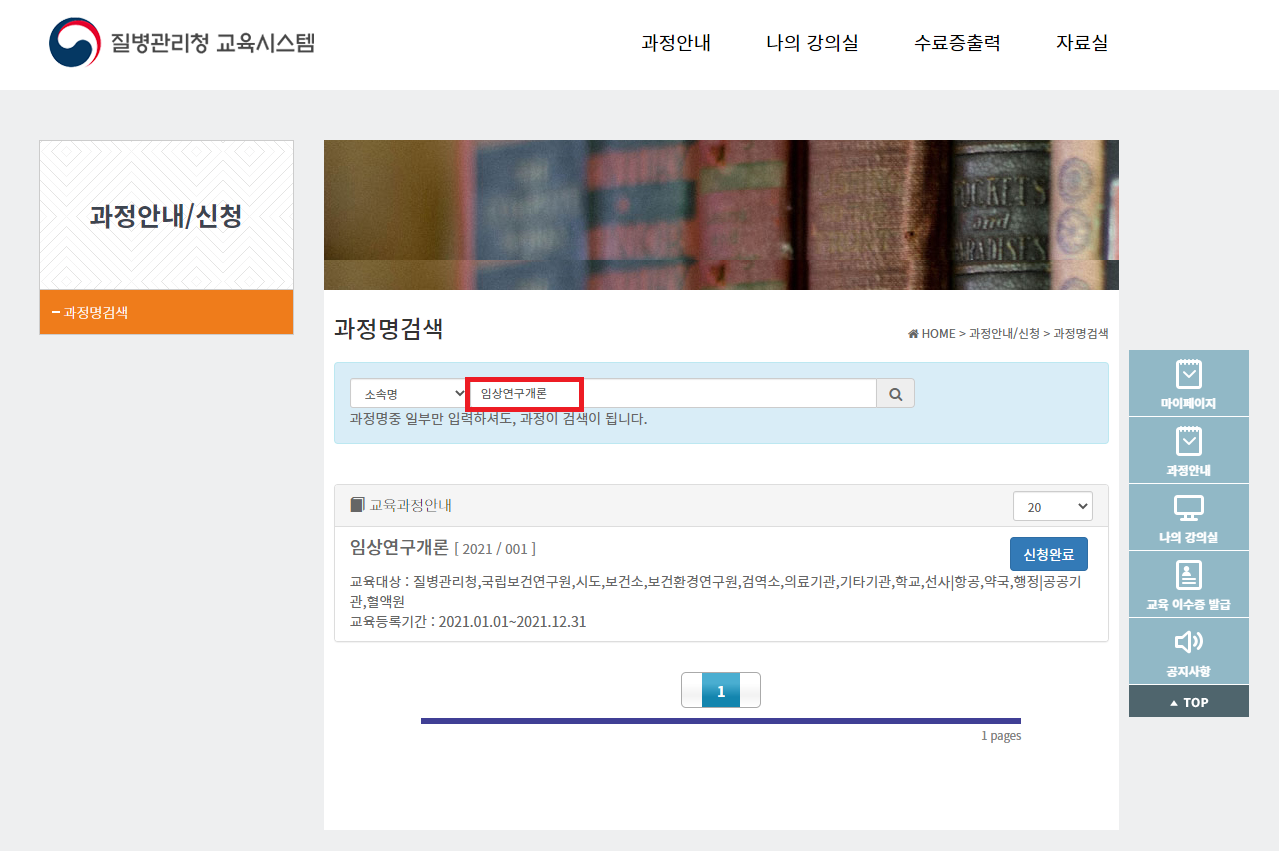

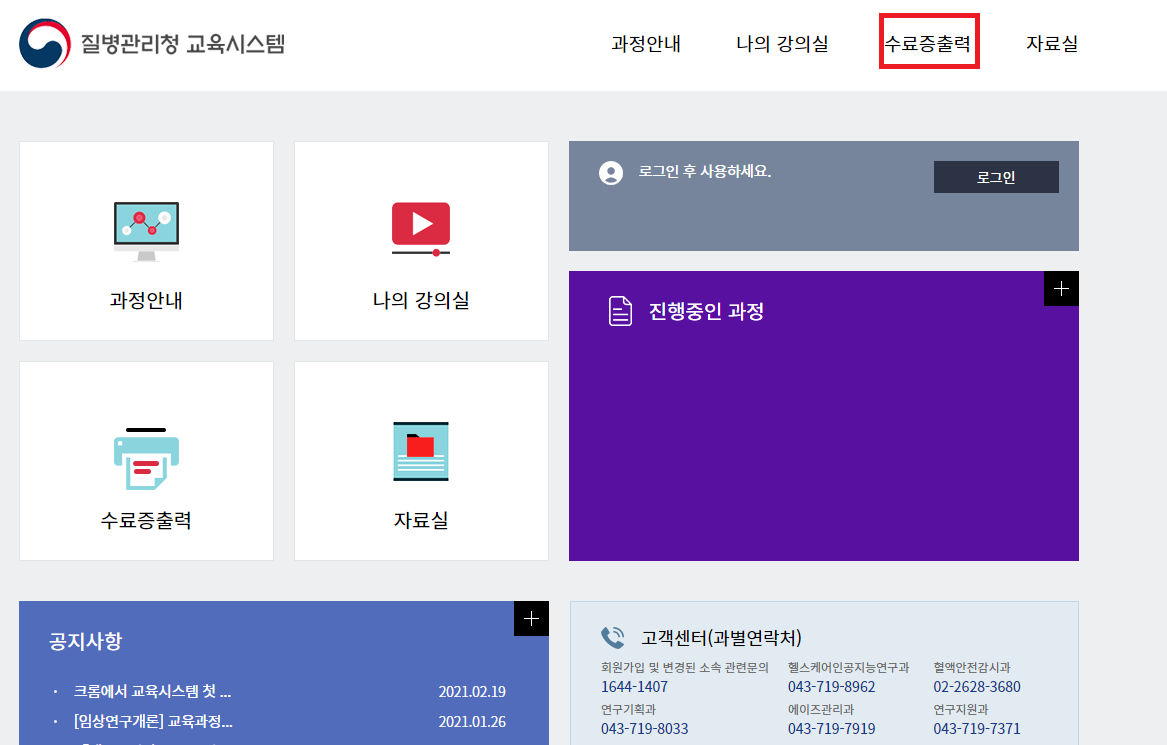

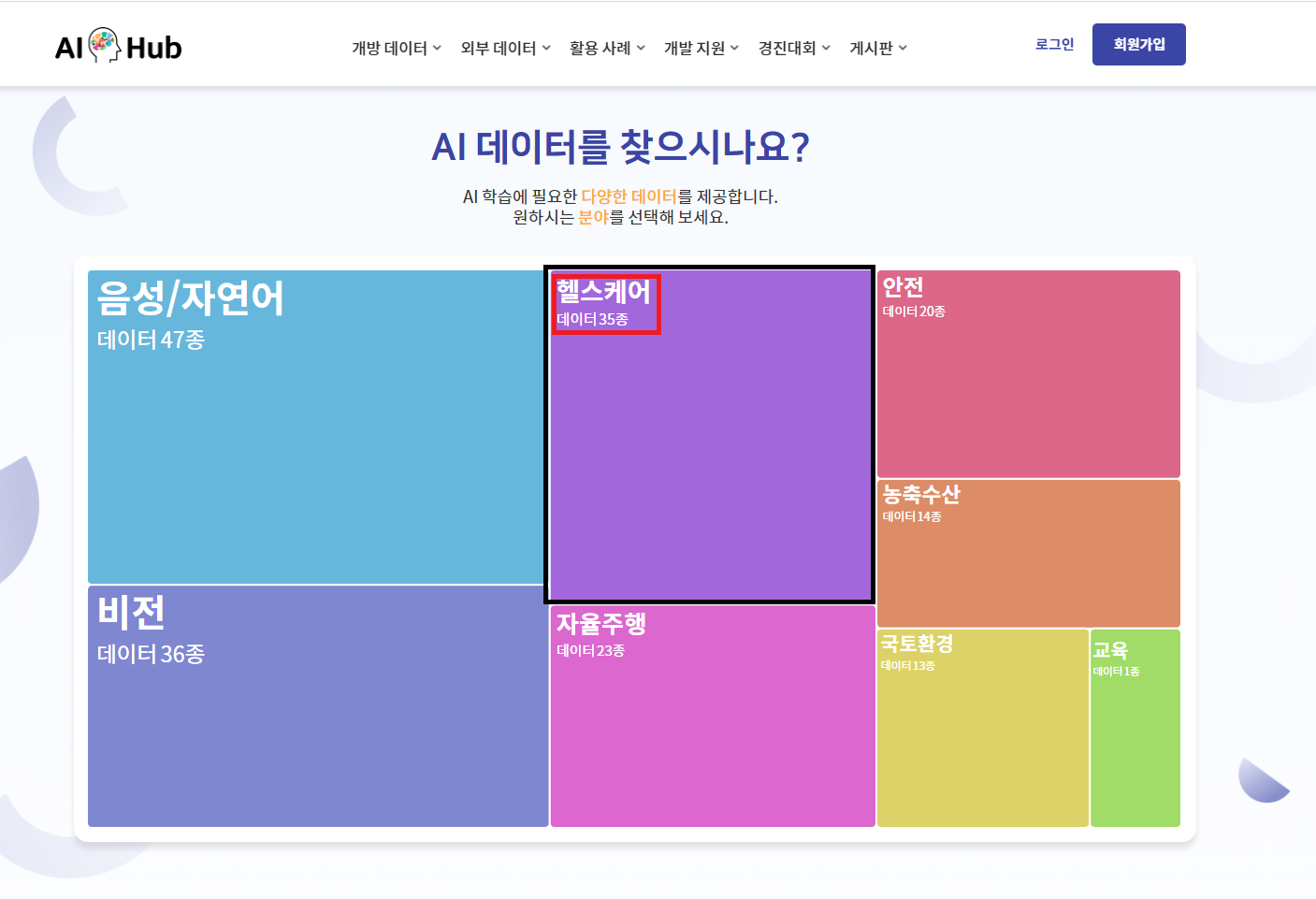

위의 사이트에 접속하시면 아래와 같은 화면을 보실 수 있습니다.

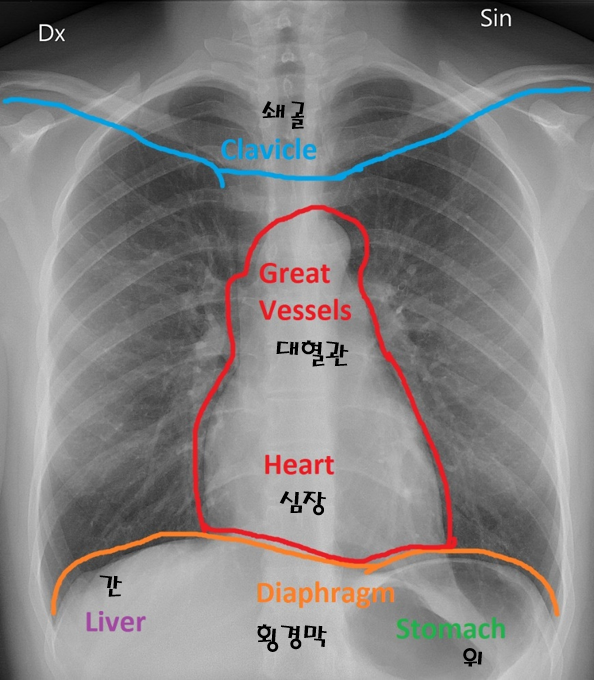

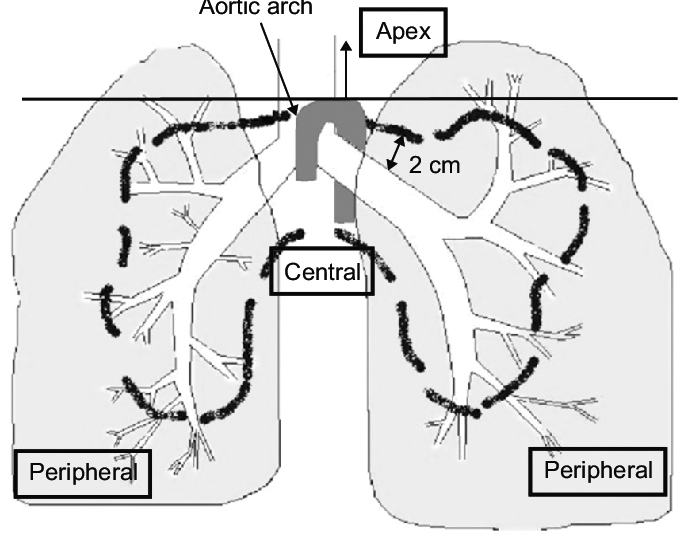

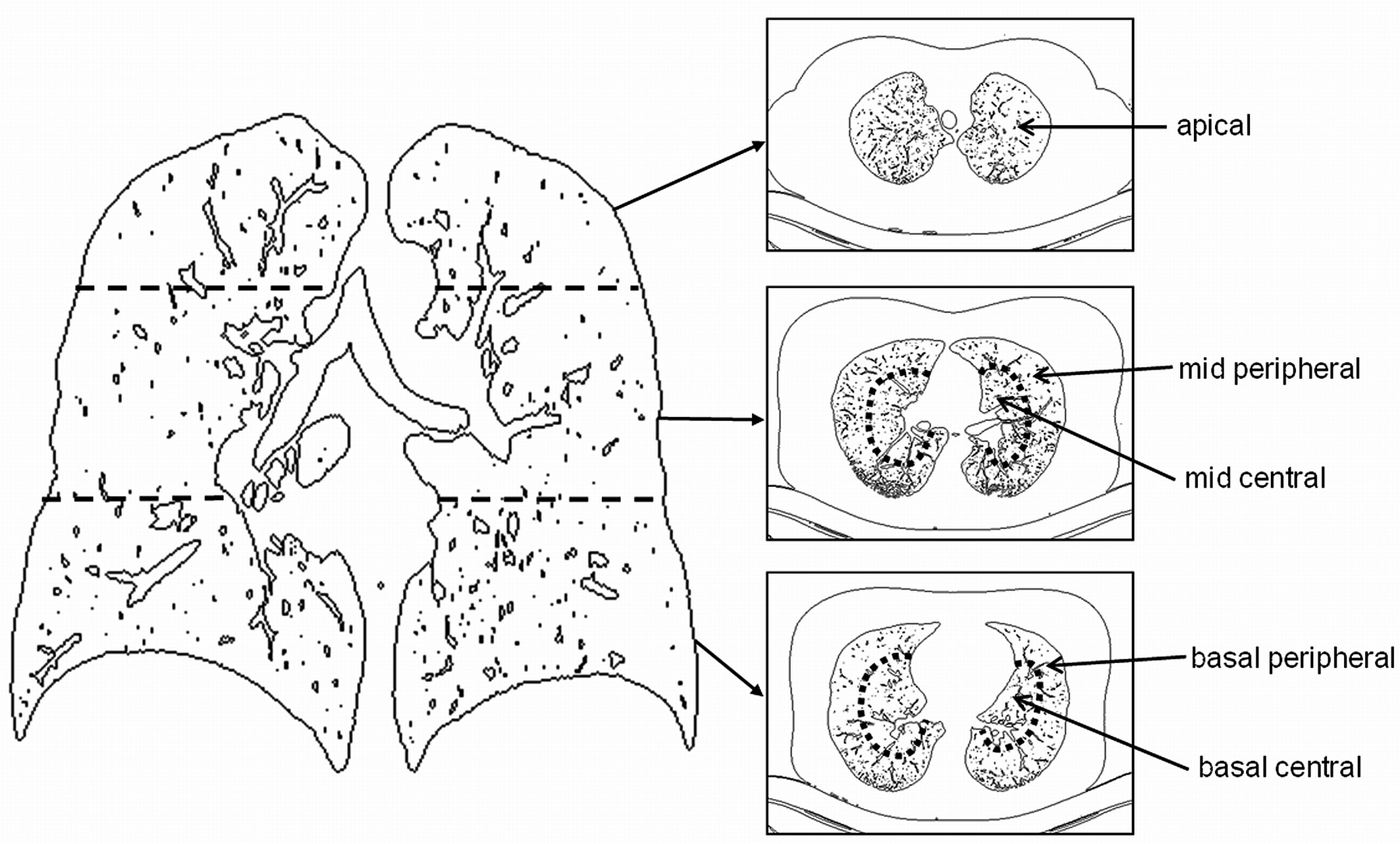

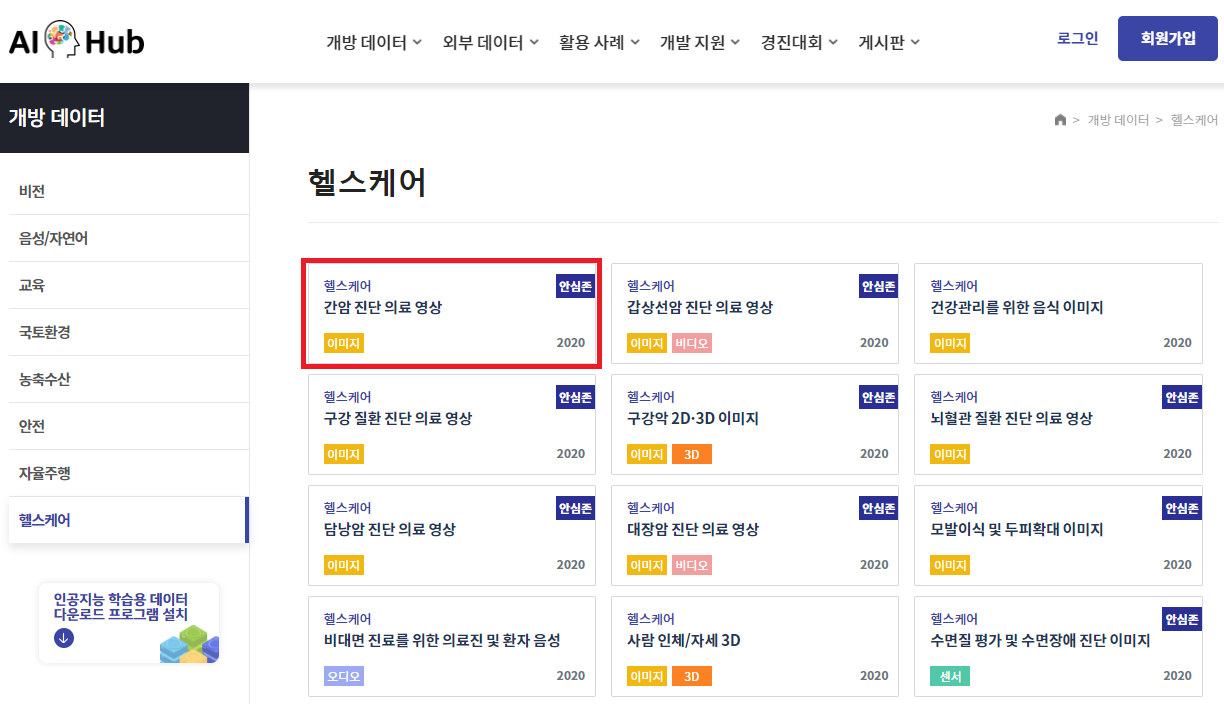

굉장히 다양한 데이터들 종류가 있는데, 이 중에 헬스케어와 관련된 데이터들은 무엇이 있는지 살펴보도록 하겠습니다 (아래 '헬스케어' 부분을 클릭하시면 됩니다)

헬스케어 데이터들을 살펴보니 '이미지', '비디오', '오디오', '3D', '센서' 등 다양한 의료데이터들이 있네요.

이 중에서 '간암 진단 의료 영상'을 클릭해서 보도록 하겠습니다.

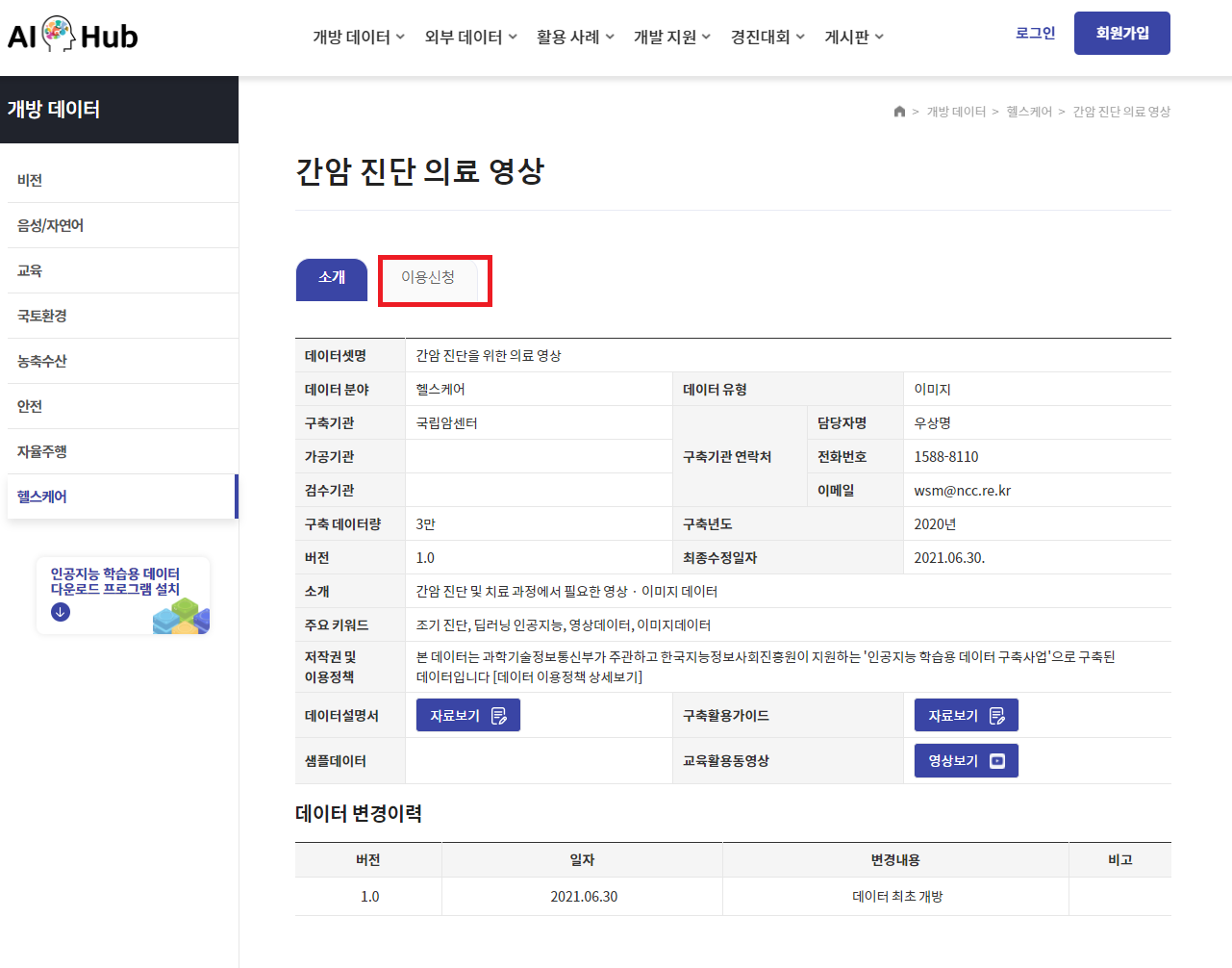

'간암 진단 의료 영상' 데이터와 관련된 정보들이 보이네요.

아래 "그림4"에서 우측 하단을 부분에서 교육활용동영상이라는 부분이 있는데, 해당 영상을 클릭하면 데이터에 대한 설명을 유튜브 영상으로 보여줍니다.

(↓↓↓간암 진단 의료 영상 관련 교육활용동영상↓↓↓)

https://www.youtube.com/watch?v=QQXQhWsy2YE

굉장히 다양한 기관에서 의료 데이터를 만들기 위해 참여했다는것을 확인할 수 있었습니다.

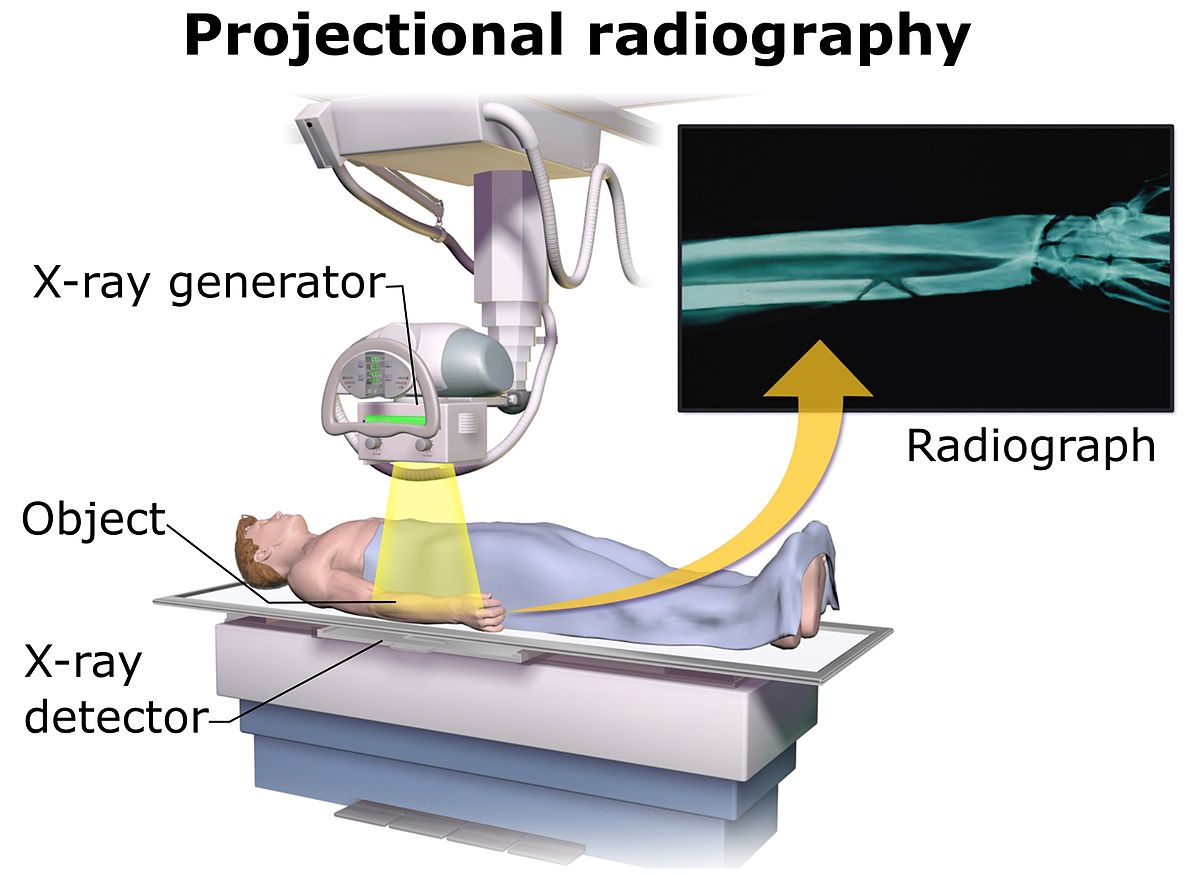

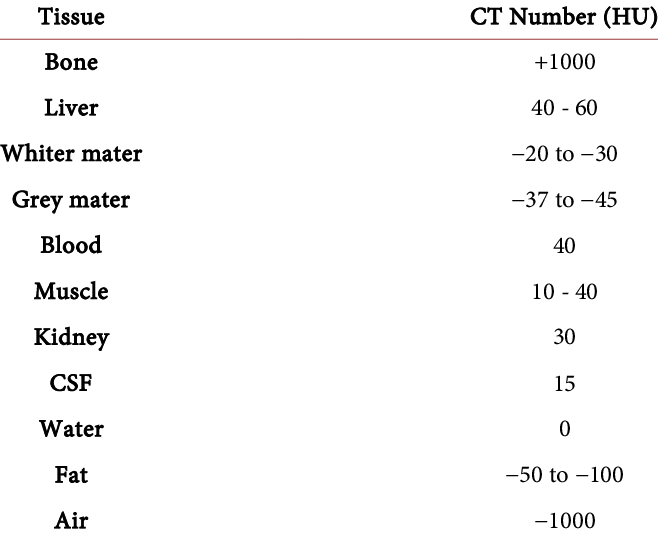

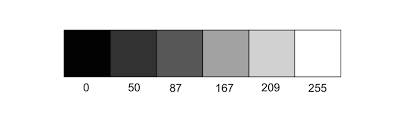

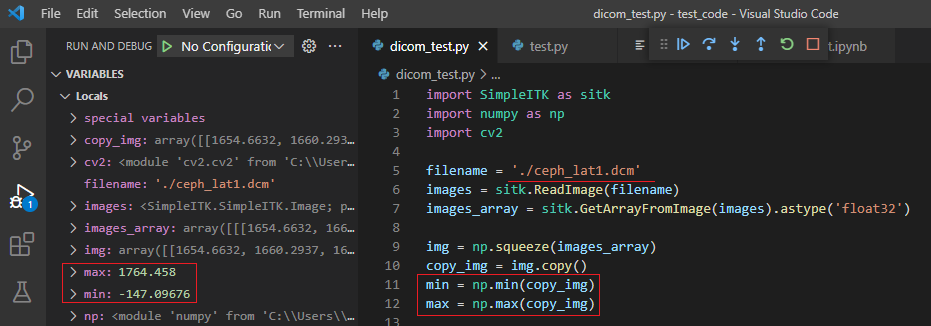

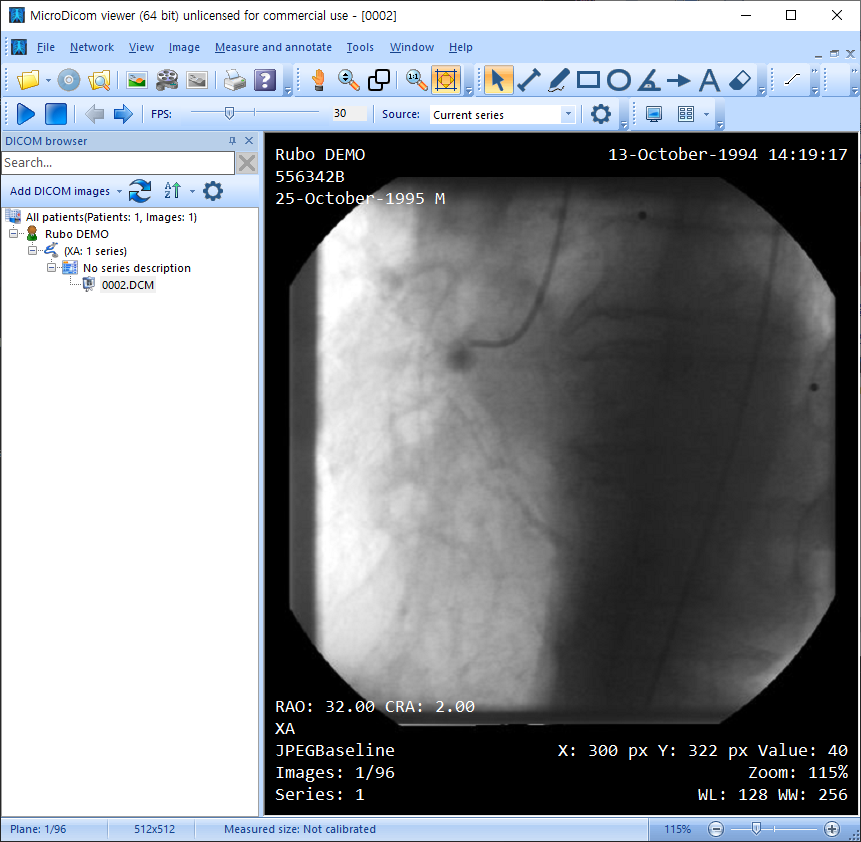

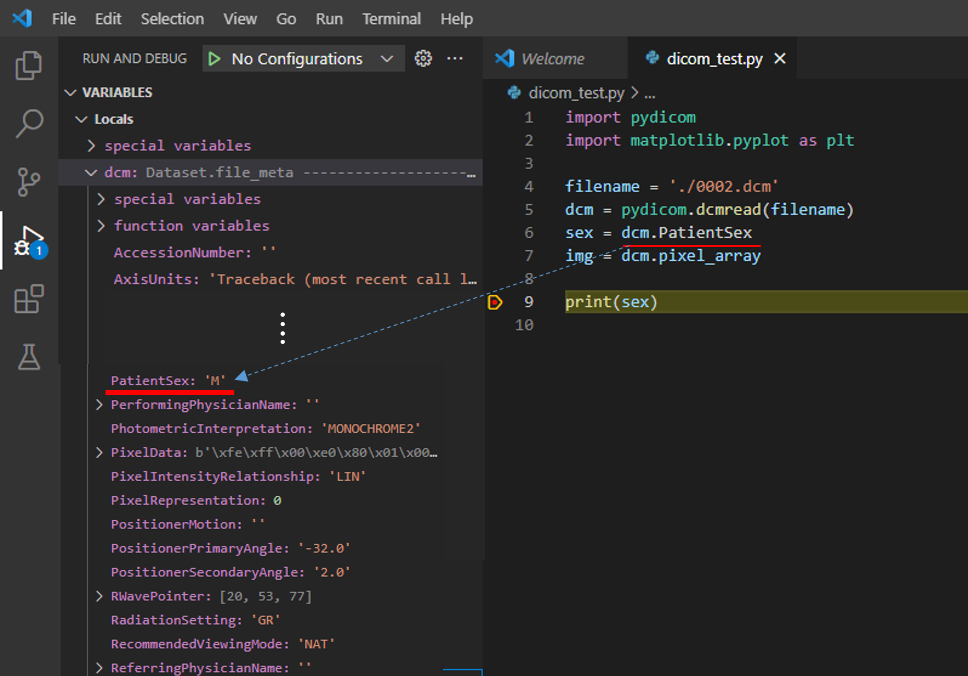

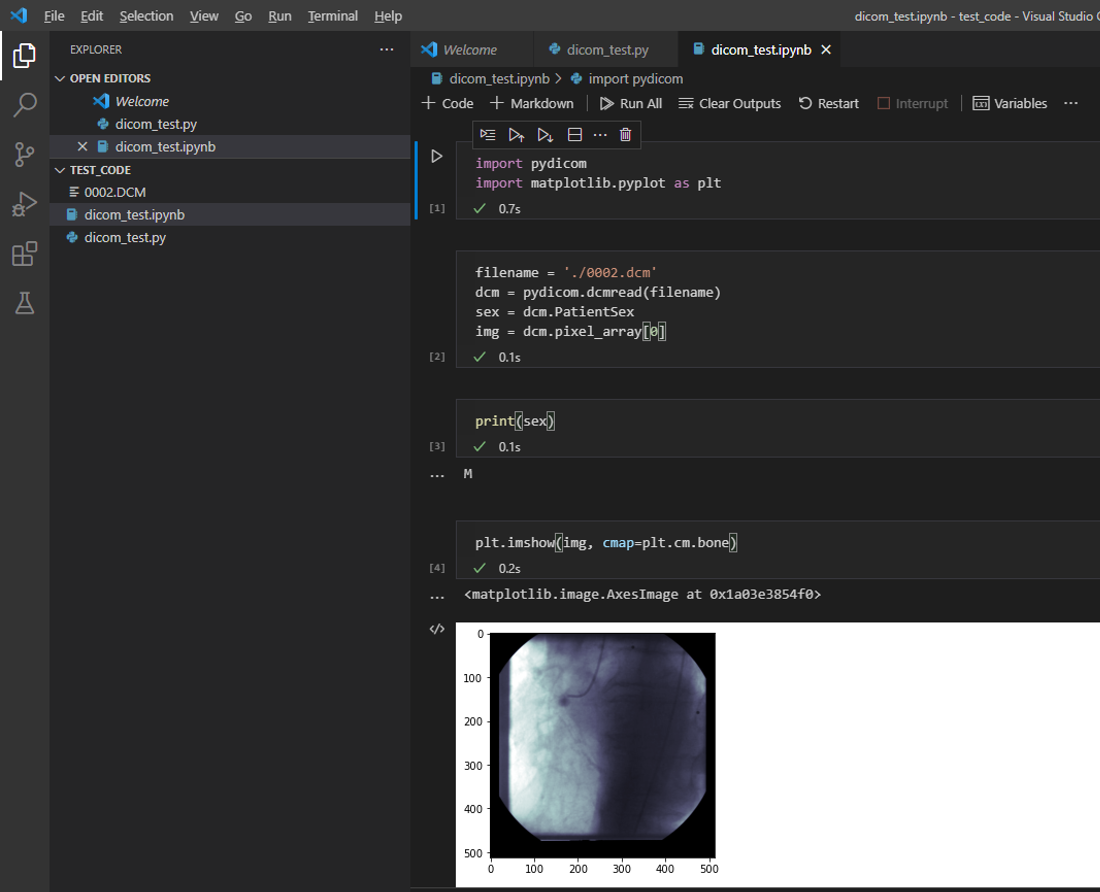

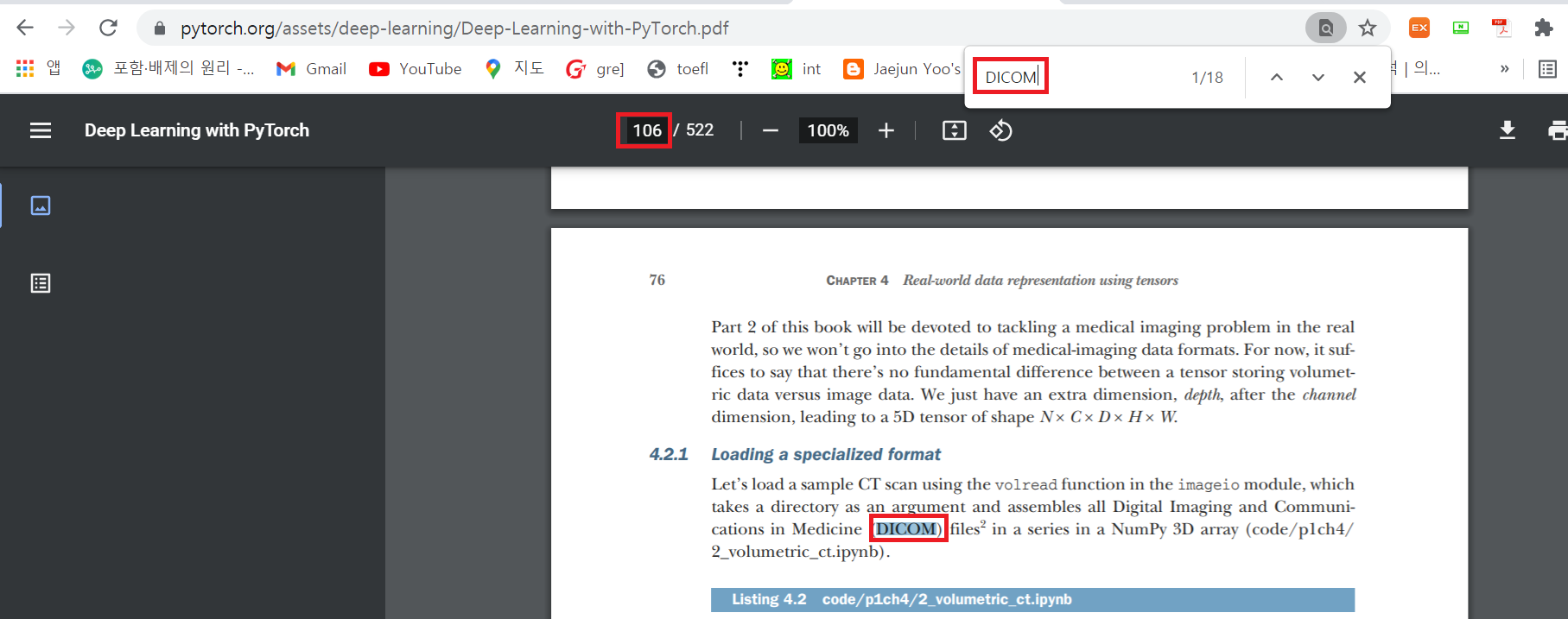

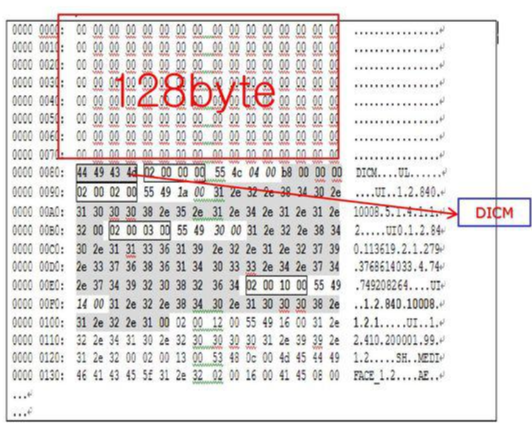

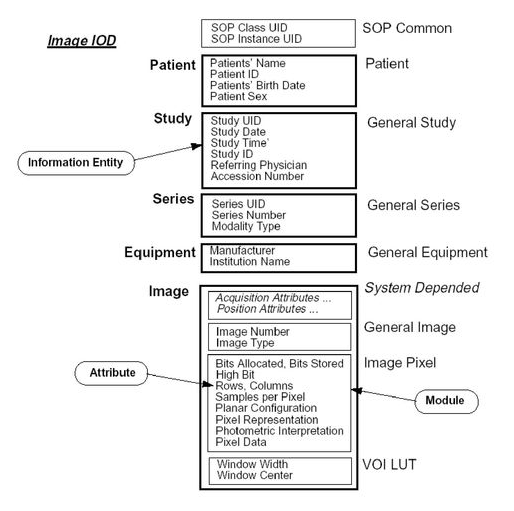

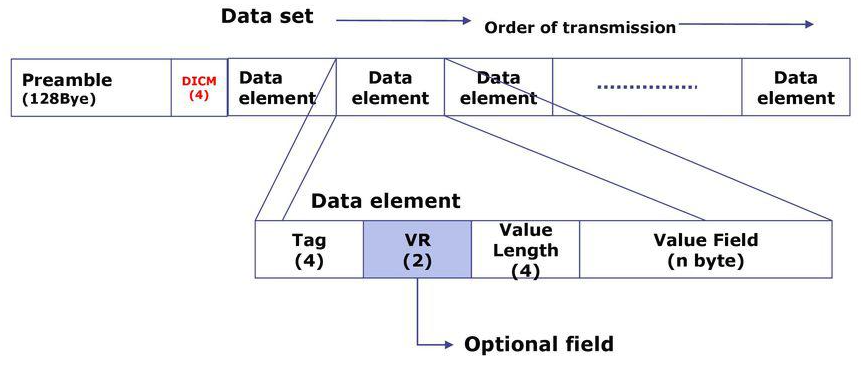

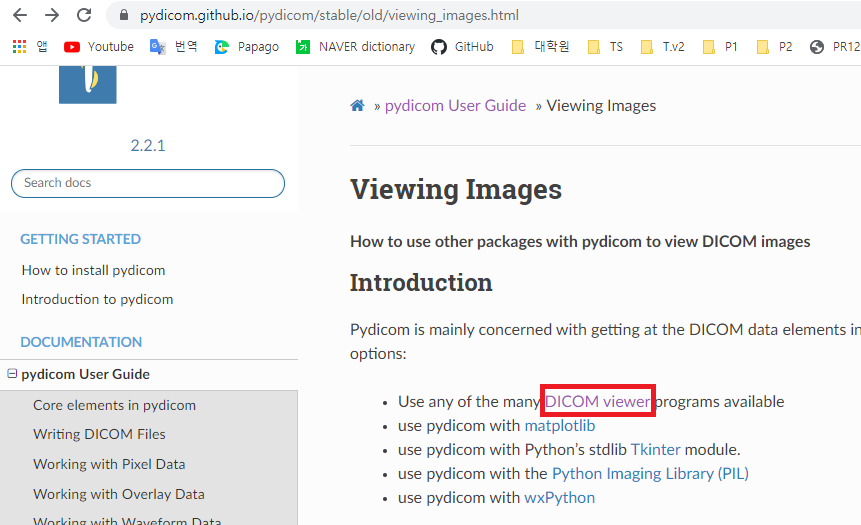

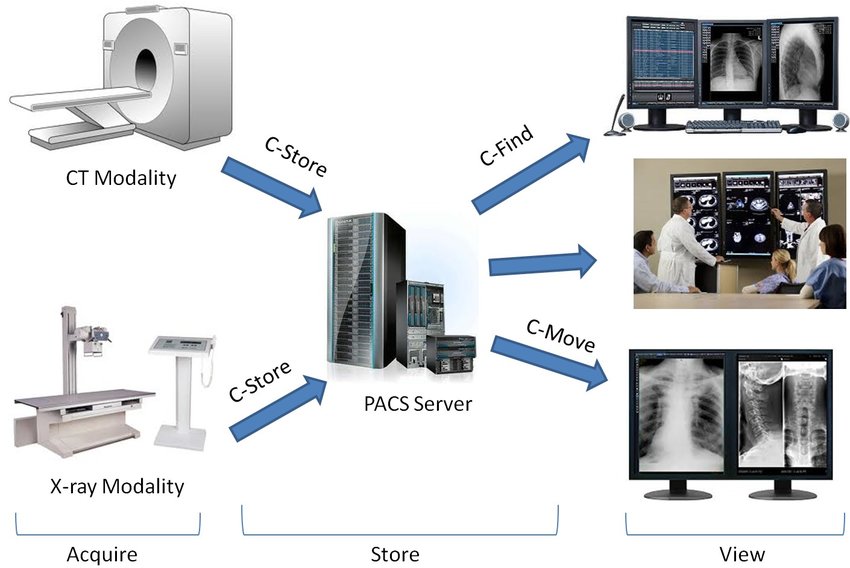

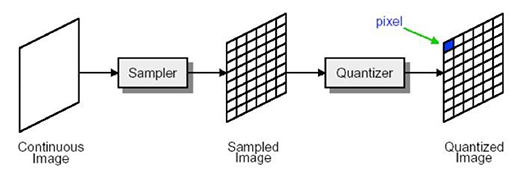

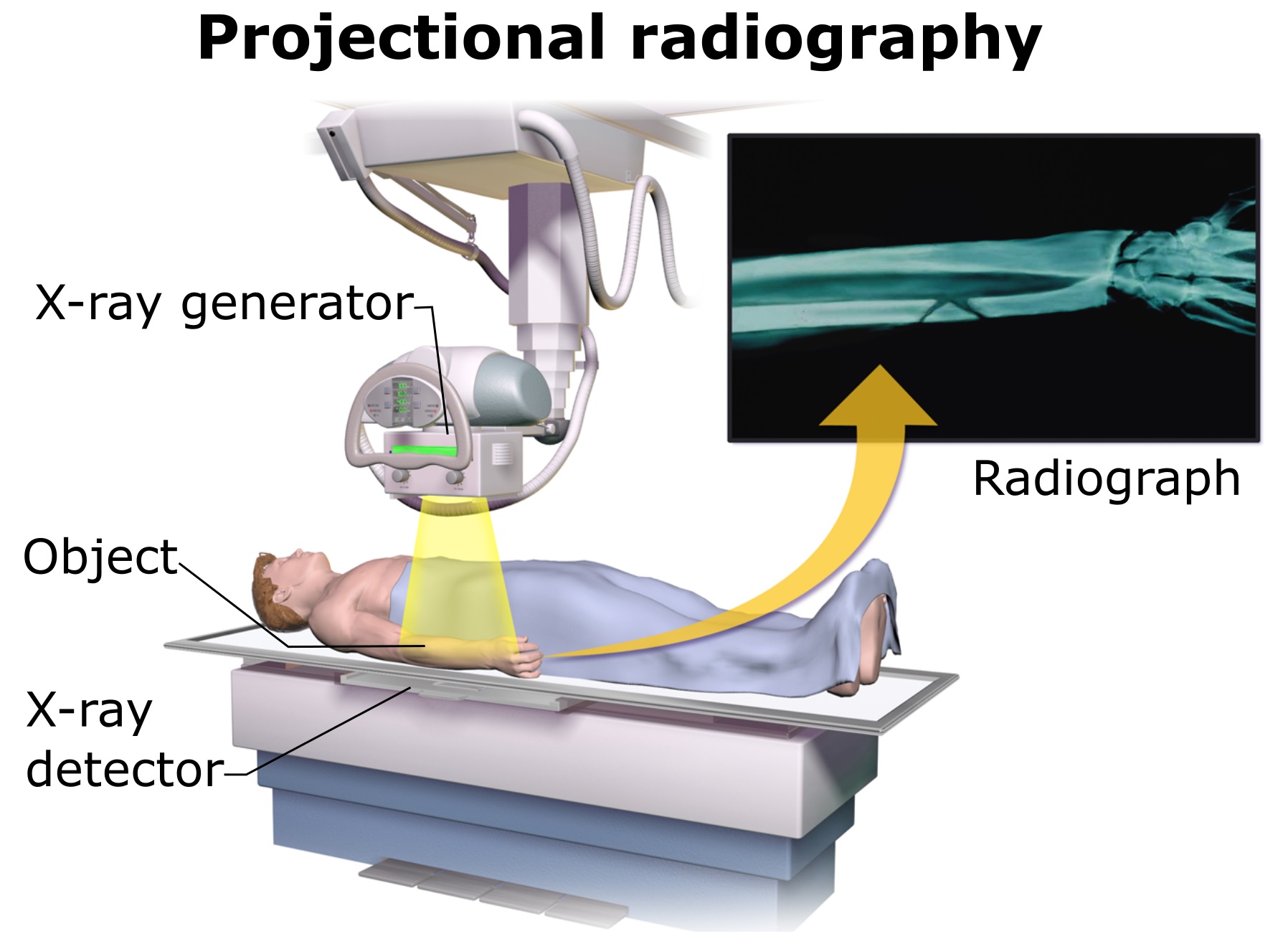

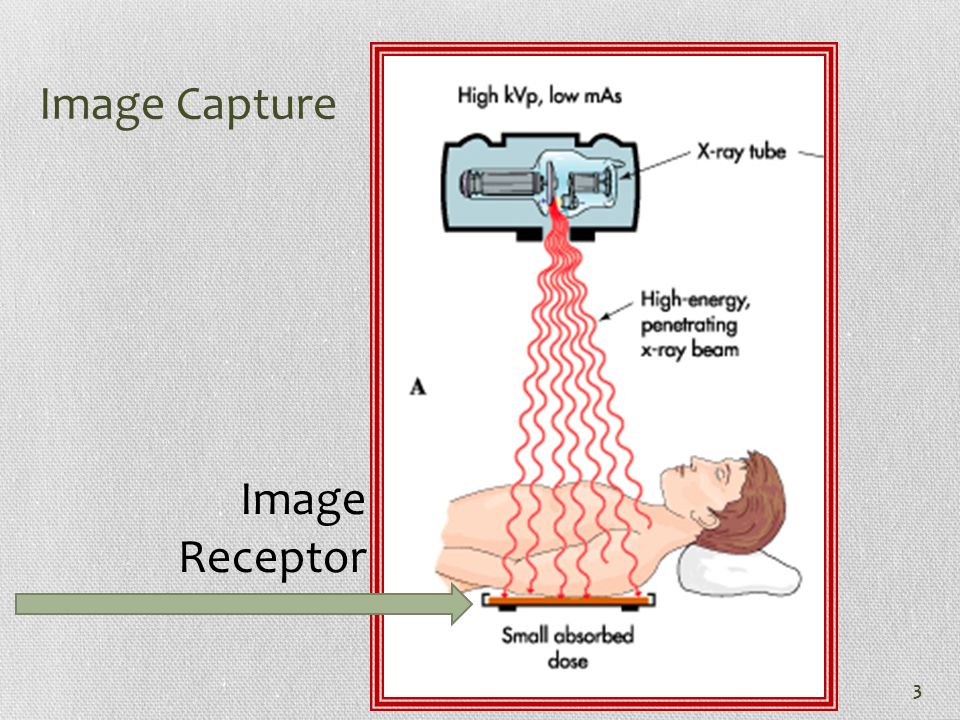

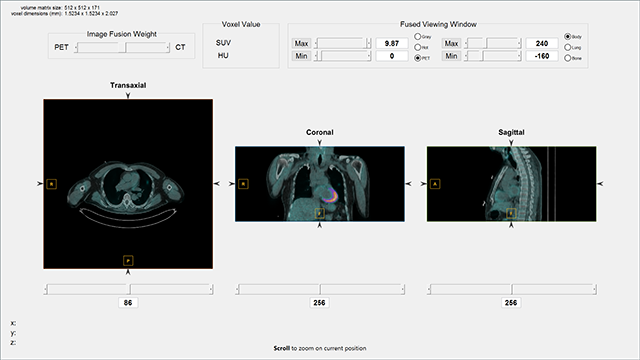

데이터 형테는 DICOM, PNG, JSON 형식으로 제공되고, 폴더 트리에 대한 설명도 자세하게 적어놓은 것을 알 수 있습니다.

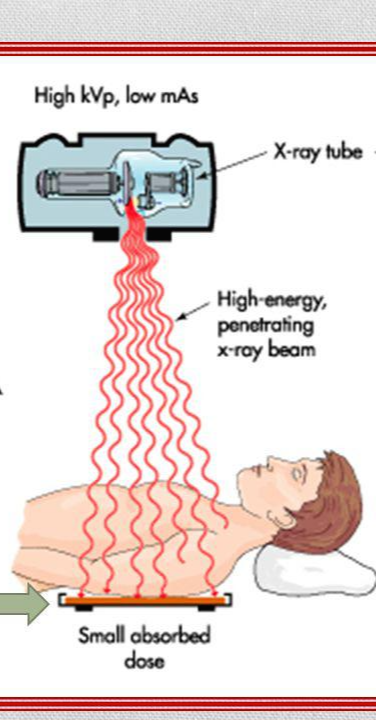

(↓↓↓DICOM 파일 관련 설명↓↓↓)

https://89douner.tistory.com/293

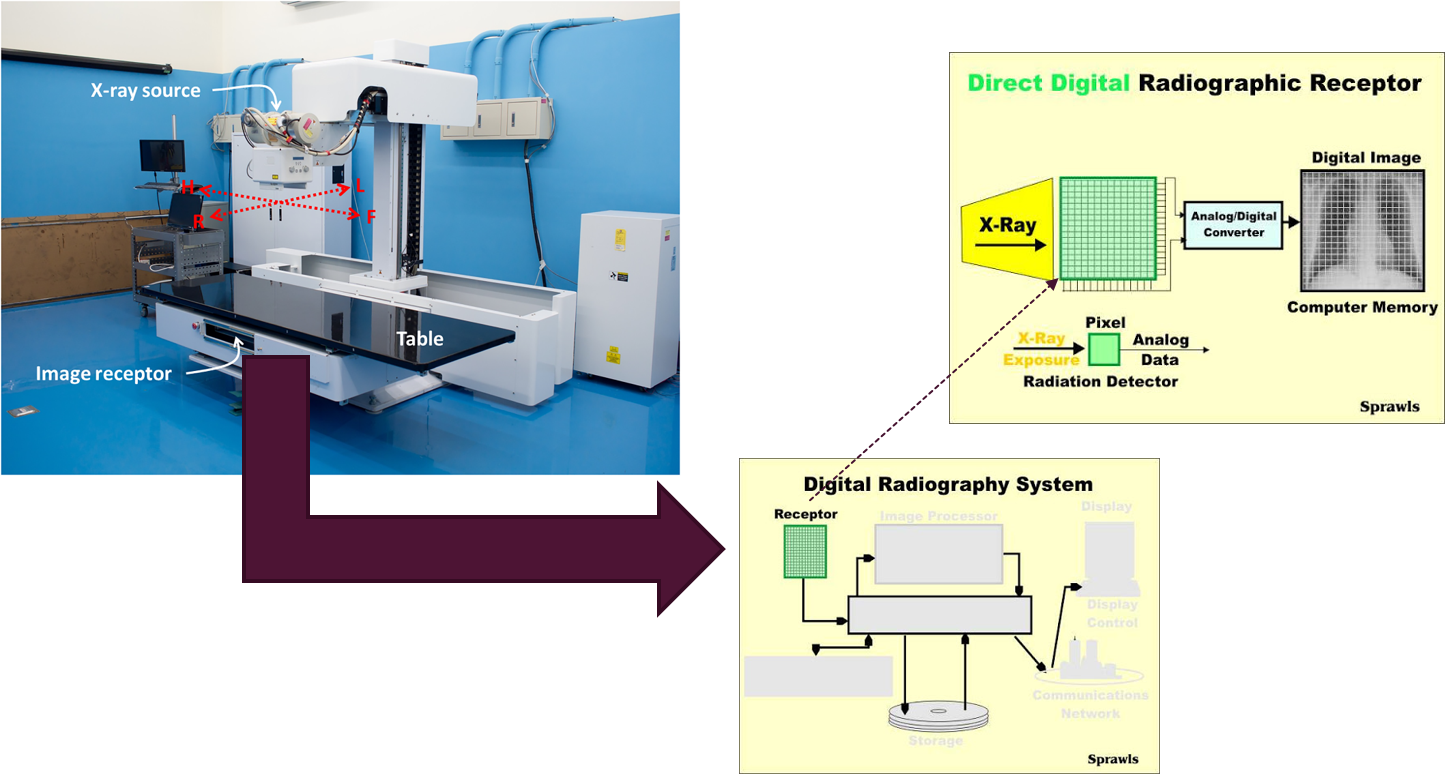

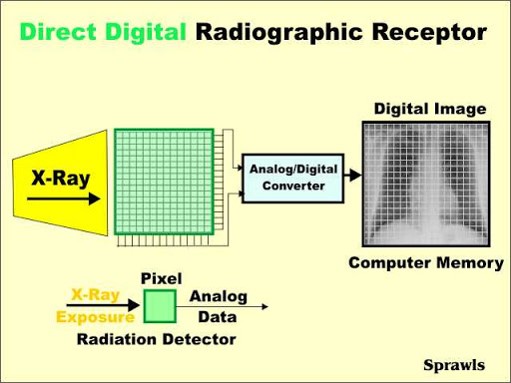

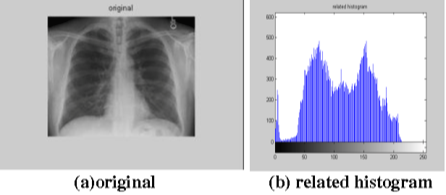

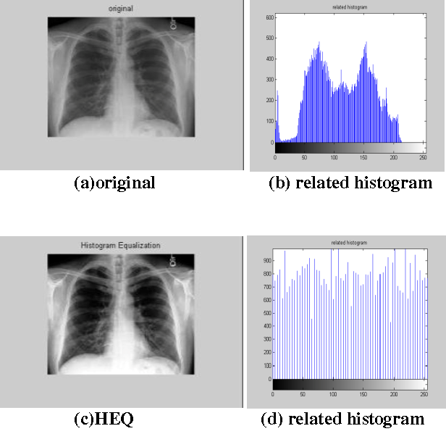

3-1. DICOM 파일이란? (Feat. Definition, PACS, digital image 습득과정)

안녕하세요. 이번 글에서는 의료 영상(Medical imaging)에서 사용하는 DICOM 파일이 어떻게 생겨났는지, 어떻게 이용되고 있는지 알아보도록 하겠습니다. 또한 DICOM이라는 것이 digital image이기 때문에,

89douner.tistory.com

그렇다면 이러한 데이터들을 어떻게 이용할 수 있을까요?

앞서 '그림3'에서 '간암 진단 의료 영상'을 클릭하고 들어가면 아래 화면이 나오는걸 '그림4'에서 확인하셨을 거에요. 이 화면에서 아래 "그림7"과 같이 '이용신청'을 클릭해줍니다.

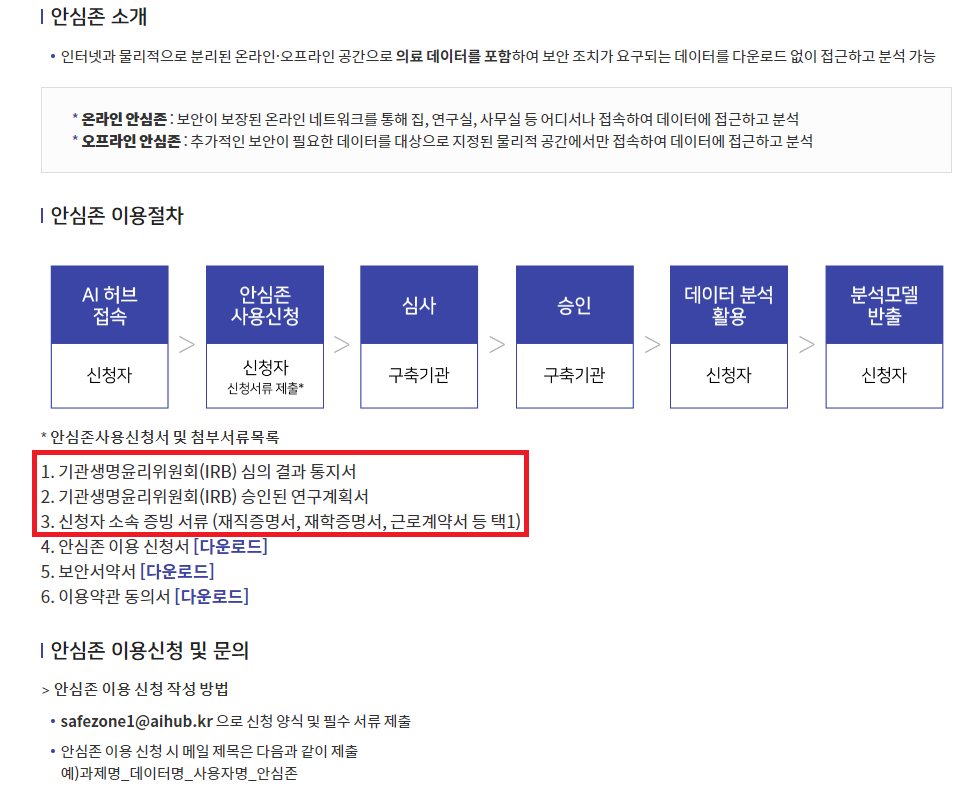

아래 화면과 같이 데이터를 신청하는 절차가 나오네요.

의료 데이터는 이용신청을 위해 좀 더 까다로운 절차가 진행됩니다.

위에서 설명하고 있는 절차중 'IRB'관련 내용은 아래 글을 참고해주시면 좋을 것 같습니다.

https://89douner.tistory.com/295

4. 한국에서 의료 데이터를 다루기 위한 행정절차

안녕하세요. 이번 글에서는 한국에서 의료 데이터를 다루기 위한 행정적 절차에 대해 소개해드리려고 합니다. 1. Motivation (의료 데이터를 사용하는데 왜 행정적 절차가 필요할까요?) 딥러닝 모델

89douner.tistory.com

이외에 "생명윤리준수서약서"도 작성하여 제출해야 하니 참고하시면 될 것 같습니다.

지금까지 '한국판 뉴딜', '디지털 뉴딜', 'AI-hub'를 소개하면서 의료 인공지능을 하시는 분들이 어떻게 양질의 데이터를 신청하고 모을 수 있는지 알아보았습니다.

감사합니다.

'Medical AI research > Background' 카테고리의 다른 글

| 5. 한국에서 의료 데이터를 다루기 위한 행정절차 (2) | 2021.10.08 |

|---|---|

| 4-2. DICOM 파일 전처리 (Feat. 이미지 저장) (6) | 2021.10.07 |

| 4-1. Python으로 dicom 데이터 읽기 (Feat. pydicom, SimpleITK) (0) | 2021.07.03 |

| 3-2. DICOM이란? (Feat. DICOM format and Viewer) (4) | 2021.07.03 |

| 3-1. DICOM 파일이란? (Feat. Definition, PACS, digital image 습득과정) (0) | 2021.07.03 |